Ja fa anys que Facebook ofereix consell a usuaris amb risc d’autolesionar-se però fins ara només podia detectar-los quan altres usuaris n’informaven amb el botó de denuncia. Fa uns dies, però, Facebook va posar en marxa un sistema algorítmic de reconeixement de patrons programat per identificar aquesta mena de casos entre el batibull d’informació que genera la plataforma. Aquest sistema d’intel·ligència artificial ha estat entrenat amb el contingut d’entrades anteriors i identifica patrons de risc. Per exemple, entrades en què un usuari parli de tristesa o de dolor així com respostes en què les amistats es mostrin preocupades.

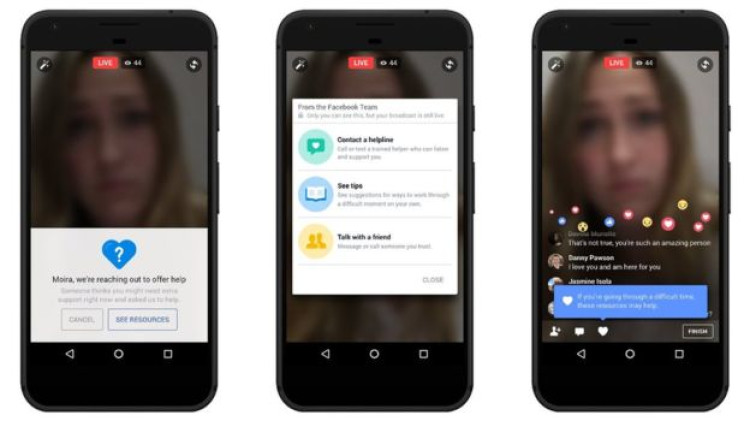

Quan el sistema detecti aquest tipus de contingut ho notificarà a un equip humà que s’encarregarà de valorar-lo ràpidament. Quan es trobin usuaris que mostrin signes de voler-se fer mal, l’empresa pretén fer-los arribar números de telèfon d’ajuda i encoratjar-los a parlar amb un amic. A més, quan utilitzin el Facebook Live, tindran a un sol clic aquesta mena de recursos. I és que Facebook no prohibirà que les persones en risc segueixin utilitzant l’aplicació de retransmissió en directe. És una decisió delicada, però cal tenir en compte que Facebook Live també és una eina que pot servir perquè algú pugui intentar prevenir el suïcidi.

Quan el sistema detecti aquest tipus de contingut ho notificarà a un equip humà que s’encarregarà de valorar-lo ràpidament. Quan es trobin usuaris que mostrin signes de voler-se fer mal, l’empresa pretén fer-los arribar números de telèfon d’ajuda i encoratjar-los a parlar amb un amic. A més, quan utilitzin el Facebook Live, tindran a un sol clic aquesta mena de recursos. I és que Facebook no prohibirà que les persones en risc segueixin utilitzant l’aplicació de retransmissió en directe. És una decisió delicada, però cal tenir en compte que Facebook Live també és una eina que pot servir perquè algú pugui intentar prevenir el suïcidi.De moment, el nou sistema d’intel·ligència artificial s’està provant només als Estats Units. El mes passat, Mark Zuckerberg va dir que algun dia la xarxa social també utilitzarà algorismes per identificar entrades penjades per terroristes i altres continguts preocupants: “De cara al futur, una de les grans oportunitats que tenim és la de protegir la gent a través de la intel·ligència artificial per entendre més ràpidament i de manera més acurada què està passant a la nostra comunitat”.